Introducción

Recuerdo cuando armé mi primera computadora y la emoción que sentí al encenderla por primera vez. Sin embargo, me di cuenta rápidamente de que algo no funcionaba como esperaba. Al investigar, descubrí la importancia de la memoria RAM, un componente clave en el rendimiento del sistema. En este tutorial, aprenderás todo sobre la memoria RAM y su relevancia en los dispositivos electrónicos. A medida que avancemos, exploraremos en detalle su funcionamiento, aplicaciones, buenas prácticas y limitaciones, así como un caso práctico concreto que ilustra su importancia en el desarrollo de software.

Fundamentos

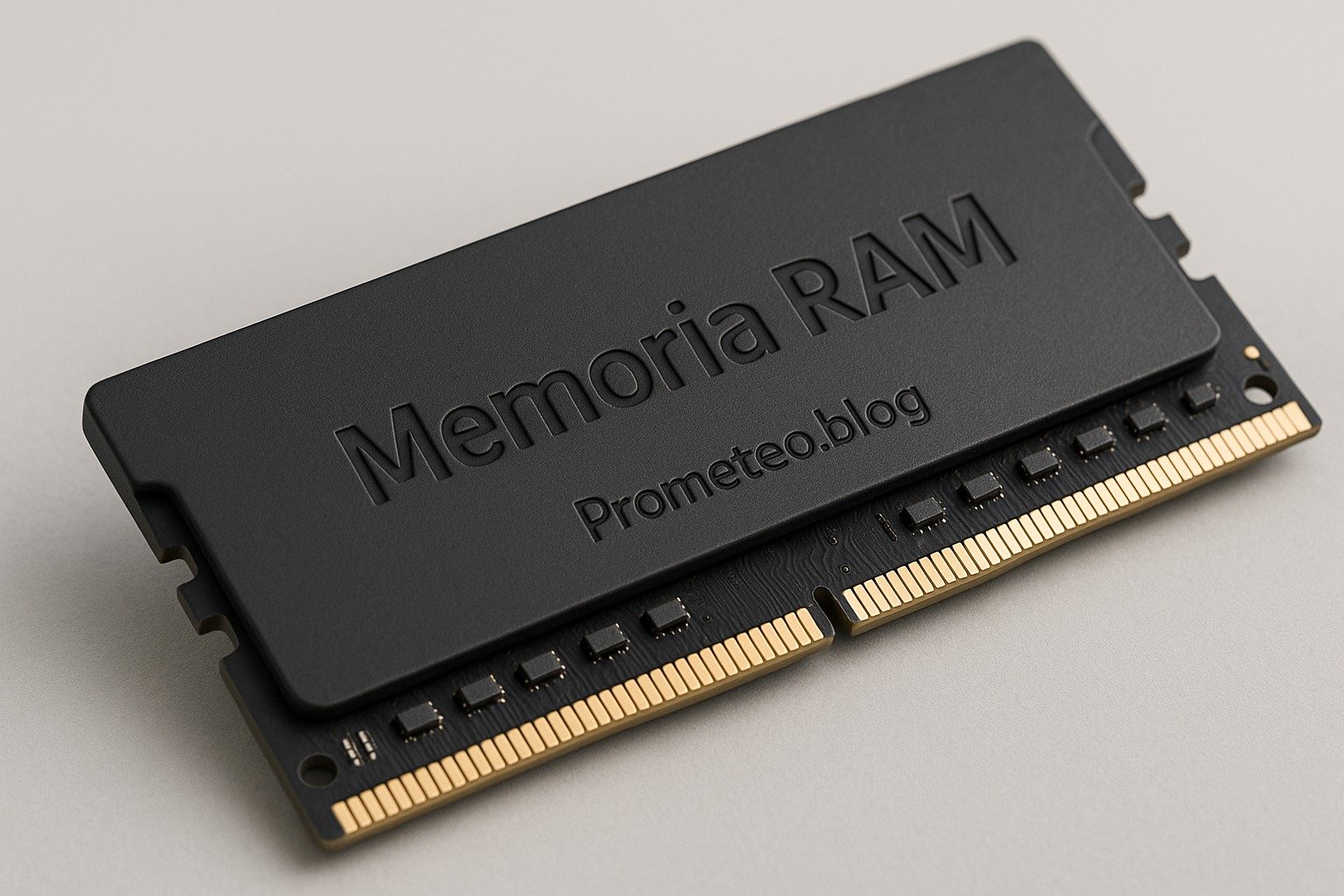

La memoria RAM (Random Access Memory) es un tipo de memoria volátil que se utiliza principalmente para almacenar datos temporales mientras los dispositivos están en funcionamiento. A diferencia de la memoria de almacenamiento, como los discos duros o las unidades de estado sólido, que conservan datos de forma permanente, la RAM solo guarda información mientras el dispositivo está encendido. Cuando apagas tu computadora, todos los datos en la RAM se pierden.

La RAM permite el acceso rápido a los datos, lo que es fundamental para el rendimiento de un sistema. Cuando abres un programa, este se carga en la RAM desde el almacenamiento permanente. Cuanta más RAM tengas, más programas podrás ejecutar simultáneamente sin que el sistema se ralentice. Por lo tanto, la cantidad de RAM en un dispositivo influye directamente en su capacidad de respuesta y velocidad.

La memoria RAM funciona mediante el uso de celdas de memoria que almacenan bits de información. Estas celdas están organizadas en filas y columnas, lo que permite un acceso rápido. Cada celda puede ser activada o desactivada, lo que representa los valores binarios de 0 y 1. Cuando se necesita acceder a un dato específico, la CPU envía una dirección a la RAM, y esta busca en sus celdas para encontrar y devolver la información solicitada.

Existen principalmente dos tipos de RAM: DRAM (Dynamic RAM) y SRAM (Static RAM). La DRAM es más común en las computadoras y necesita ser refrescada constantemente, mientras que la SRAM es más rápida pero más cara, por lo que se utiliza generalmente en cachés de CPU. La elección entre DRAM y SRAM depende del uso específico que se le dará a la memoria y del equilibrio entre costo y rendimiento que se desee alcanzar.

La memoria RAM también se clasifica según su velocidad y capacidad. La velocidad se mide en megahercios (MHz) y afecta la rapidez con la que los datos pueden ser leídos y escritos. Por otro lado, la capacidad de la RAM se mide en gigabytes (GB) y determina cuanta información puede ser almacenada temporalmente. En un mundo donde las aplicaciones son cada vez más pesadas y complejas, contar con una cantidad adecuada de RAM se vuelve esencial.

Cómo funciona

El ciclo de trabajo de la memoria RAM implica varios procesos. Primero, la CPU envía una señal para leer o escribir datos en la RAM. Luego, la memoria localiza la dirección deseada y realiza la operación. Este proceso es extremadamente rápido, lo que permite que múltiples tareas se ejecuten simultáneamente. La rapidez en la que la RAM puede acceder y manipular datos es lo que proporciona a los sistemas la capacidad de ejecutar aplicaciones de manera eficiente.

A medida que los programas se vuelven más complejos y requieren más recursos, la cantidad de RAM necesaria también aumenta. Por ejemplo, aplicaciones de edición de video o juegos modernos requieren una cantidad considerable de memoria para funcionar sin problemas. Por lo tanto, es recomendable actualizar la RAM si experimentas lentitud en el rendimiento de tu dispositivo. La actualización de RAM no solo mejora la velocidad, sino que también permite una multitarea más efectiva, lo que resulta en una experiencia de usuario mucho más fluida.

En resumen, la memoria RAM es esencial para el funcionamiento eficiente de cualquier dispositivo electrónico. Sin ella, el rendimiento sería significativamente limitado y las tareas diarias se volverían imposibles. A medida que continúas explorando el mundo de la tecnología, recordarás siempre la importancia de la RAM en tu computadora o cualquier otro dispositivo que uses. La elección de la RAM adecuada puede ser la diferencia entre un sistema que responde rápidamente y uno que lucha por mantener el ritmo de las tareas diarias.

Aplicaciones

La memoria RAM tiene múltiples aplicaciones en el ámbito de la tecnología, y su importancia se extiende a diversos dispositivos y contextos. A continuación, se describen algunas de las aplicaciones más relevantes:

- Computadoras de escritorio y portátiles: La RAM es fundamental para el rendimiento general de las computadoras. Permite la ejecución de múltiples aplicaciones simultáneamente, lo que es esencial para tareas como la navegación web, la edición de documentos y el uso de software de diseño gráfico.

- Dispositivos móviles: En smartphones y tabletas, la RAM es crucial para el rendimiento de las aplicaciones y la multitarea. Con la creciente complejidad de las aplicaciones móviles, contar con suficiente RAM se ha vuelto vital para ofrecer una experiencia de usuario fluida.

- Videojuegos: En el desarrollo y la ejecución de videojuegos, la RAM es esencial para almacenar texturas, modelos 3D y otros elementos gráficos que se necesitan en tiempo real. Los juegos modernos requieren grandes cantidades de RAM para funcionar sin problemas, especialmente en configuraciones de alta definición.

- Servidores: En entornos de servidor, la RAM es crítica para manejar múltiples solicitudes de usuarios y aplicaciones al mismo tiempo. Los servidores que ejecutan aplicaciones empresariales, bases de datos o servicios en la nube requieren grandes cantidades de RAM para garantizar un rendimiento óptimo.

- Inteligencia Artificial y Machine Learning: En el campo de la inteligencia artificial, la RAM es importante para procesar grandes volúmenes de datos y realizar cálculos complejos. Los modelos de aprendizaje profundo, por ejemplo, requieren una cantidad considerable de RAM para entrenarse y ejecutarse de manera eficiente.

La versatilidad de la RAM la convierte en un componente esencial en casi todos los dispositivos electrónicos modernos. A medida que la tecnología avanza, la demanda de RAM seguirá creciendo, impulsando la necesidad de innovaciones en su diseño y fabricación.

Buenas prácticas/limitaciones

Al trabajar con memoria RAM, es fundamental seguir ciertas buenas prácticas y ser consciente de sus limitaciones. Aquí hay algunas recomendaciones:

- Verifica la compatibilidad: Antes de comprar RAM, asegúrate de que sea compatible con tu placa base. Consulta el manual de tu placa o el sitio web del fabricante para conocer las especificaciones necesarias.

- Usa módulos idénticos: Si decides agregar más RAM a tu sistema, es recomendable que los módulos sean del mismo tipo, marca y especificaciones. Esto puede prevenir problemas de estabilidad y rendimiento.

- Evalúa tus necesidades: Antes de actualizar la RAM, considera qué tipo de aplicaciones utilizas y cuánto espacio realmente necesitas. A veces, una actualización de software o una limpieza del sistema puede ser suficiente para mejorar el rendimiento.

- Considera la latencia: La latencia de la RAM puede afectar el rendimiento general del sistema. Al elegir RAM, busca módulos que ofrezcan una latencia adecuada para tus necesidades específicas.

- Realiza pruebas de estrés: Después de instalar nueva RAM, es recomendable realizar pruebas de estrés para asegurarte de que funcione correctamente y no presente errores. Existen herramientas disponibles que pueden ayudarte a verificar la estabilidad de tu sistema.

Es importante tener en cuenta que la RAM no es una solución mágica para todos los problemas de rendimiento. Si tu sistema tiene un procesador lento o un disco duro antiguo, la adición de más RAM puede no proporcionar la mejora esperada. En estos casos, puede ser necesario considerar una actualización más integral del hardware.

Caso práctico concreto

Imaginemos que eres un desarrollador de videojuegos, y has decidido crear un nuevo juego que requiere gráficos avanzados y una jugabilidad fluida. Para lograr esto, necesitas una computadora capaz de manejar grandes volúmenes de datos de manera eficiente. Aquí es donde la memoria RAM se convierte en un factor crucial.

En el desarrollo de videojuegos, la RAM desempeña un papel vital en el almacenamiento de texturas, modelos 3D y otros elementos gráficos que se necesitan en tiempo real. Cuando un jugador está en una escena del juego, la RAM debe ser capaz de cargar rápidamente todos los recursos necesarios para que la experiencia sea fluida. Si la RAM es insuficiente, el juego puede experimentar retrasos o ‘lag’, lo que puede frustrar al jugador y afectar su experiencia general.

Supongamos que decides desarrollar un juego con gráficos en 3D. Para ello, es probable que utilices un motor de juegos como Unity o Unreal Engine. Ambos motores requieren una cantidad considerable de RAM para funcionar correctamente. Si tu computadora tiene solo 4GB de RAM, podrías encontrarte limitado a crear juegos más simples. Sin embargo, si actualizas a 16GB, tendrás espacio suficiente para trabajar con texturas de alta resolución y realizar pruebas en tiempo real sin problemas.

Además, al desarrollar videojuegos, a menudo trabajas en múltiples aplicaciones al mismo tiempo. Por ejemplo, puedes tener el motor de juego abierto, un software de diseño gráfico para crear modelos, y un programa de edición de sonido. Si no tienes suficiente RAM, tu computadora se ralentizará al intentar gestionar todas estas tareas simultáneamente. Esto no solo afecta tu productividad, sino que también puede llevar a errores en el desarrollo, como fallos en el motor o pérdidas de progreso.

Para maximizar tu eficiencia, es recomendable tener al menos 16GB de RAM si trabajas en el desarrollo de videojuegos. Esta cantidad te permitirá ejecutar tu motor de juego, software de diseño y otras herramientas sin problemas. En algunos casos, incluso podrías necesitar 32GB o más, especialmente si trabajas con proyectos muy complejos o en alta definición.

Otro aspecto a considerar es el uso de herramientas de colaboración. En muchos casos, los desarrolladores de videojuegos trabajan en equipo, y es posible que necesiten compartir recursos y colaborar en tiempo real. Esto puede requerir una capacidad de RAM aún mayor, ya que cada miembro del equipo puede estar ejecutando múltiples aplicaciones simultáneamente. Por lo tanto, tener suficiente memoria RAM no solo mejora tu experiencia individual como desarrollador, sino que también facilita la colaboración con otros.

En conclusión, la memoria RAM es fundamental en el desarrollo de videojuegos. No solo afecta el rendimiento de tu computadora, sino que también influye en tu capacidad para crear y colaborar de manera efectiva. Si estás considerando involucrarte en el desarrollo de videojuegos, asegúrate de invertir en una cantidad adecuada de RAM para optimizar tu flujo de trabajo y mejorar tu experiencia general.

Errores comunes y cómo evitarlos

- No verificar la compatibilidad de la RAM con tu placa base. Asegúrate de que el tipo y la velocidad de la RAM sean compatibles con tu sistema.

- Instalar RAM de diferentes marcas o especificaciones. Siempre es mejor usar módulos de RAM idénticos para evitar problemas de estabilidad.

- Subestimar la cantidad de RAM necesaria. Considera tus necesidades de uso y el tipo de aplicaciones que planeas ejecutar.

- Ignorar la latencia de la RAM. La latencia puede afectar el rendimiento, así que elige módulos con una latencia adecuada para tus necesidades.

- No realizar pruebas de estrés. Después de instalar nueva RAM, realiza pruebas para asegurarte de que funcione correctamente y no presente errores.

Conclusión

La memoria RAM es un componente esencial en cualquier dispositivo electrónico, y su correcto funcionamiento es clave para lograr un rendimiento óptimo. A medida que avances en tu aprendizaje sobre tecnología, recuerda la importancia de elegir la RAM adecuada para tus necesidades. Si tienes dudas sobre cómo seleccionar la mejor memoria RAM para tu sistema, no dudes en buscar más información o consultar a un experto. ¡Tu experiencia tecnológica puede mejorar significativamente con la RAM correcta! Más información en electronicsengineering.blog

Lecturas de terceros

- Tutorial ensamblador (V) – La memoria de los MSX – MSXBlog

- Instalar Memoria RAM DDR3 – Cómo Montar/Armar una Computadora Guía Manual Tutorial Course Full HD Descargar Download Web Diseño Design Guide Gratis Free Mega Mediafire

- La Memoria RAM – Cómo Montar/Armar una Computadora Guía Manual Tutorial Course Full HD Descargar Download Web Diseño Design Guide Gratis Free Mega Mediafire

Encuentra este producto y/o libros sobre este tema en Amazon

Como afiliado de Amazon, gano con las compras que cumplan los requisitos. Si compras a través de este enlace, ayudas a mantener este proyecto.

Quiz rápido